Bist Du dir sicher, das Du das so stehen lassen möchtest?^^ Weil den Witz, habe ich in all den Jahren noch NICHT gehört über meine Arbeit.Mal abgesehen vom Nvidia-Bashing hier.

Letztlich haben sie Recht. Ich sehe auch keinen gesellschaftlichen Mehrwert in Kryptowährungen. Das war aber auch schon vor Mining so.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

News Nvidia: "Kryptowährungen liefern keinen gesellschaftlichen Mehrwert" - Fokus soll lieber auf KI gelegt werden

- Ersteller PCGH-Redaktion

- Erstellt am

Nartürlich ist es für Nvidia bequem zu sagen das hat keinen Mehrwert für die Geselschaft hat, mal davon abgesehen was sie daran verdient haben und jetzt nicht mehr. Das gleiche mit der KI sie werden sehr gut daran verdienen. Mich stört nicht das sie Geld machen sondern wie sie es machen. Mit dem Mining könnten sie ein neues LvL an Preise ansiedeln und mit der KI geschichte können sie es in die länge ziehen damit bleibt der Markt mit der Preisgestaltung weit oben und wir verbrauch haben wenig was dagegen zu tuen.

Bonsai

Komplett-PC-Käufer(in)

Die Tatsache, dass Nvidia bei dem Bedarf zugeschnittene Produkte hergestellt hat, bedeutet nicht, dass dies dies Teil der strategischen Zielsetzung/Orientierung des Unternehmens ist, das wird auch klar, wenn man die News in Gänze liest.

Ob Nvidia einer anderen Meinung ist, müsstest du belegen. Die Tatsache, dass sie versucht haben den Bedarf zu decken ist in einem kapitalistischen System natürlich notwendig. Diese Verpflichtung ergibt sich rein aus den Interessen der Shareholder.

Natürlich hast du Recht, dass das Unternehmen profitorientiert handeln sollte (der Aktienkurs schaut gut aus) und zu belegen was ein Unternehmen (besteht ja nicht nur aus einem CTO) "denkt" ist nicht wirklich möglich - auch nicht heute nach einer Aussage eines Einzelnen (auch wenn er ein CTO ist).

Zitat aus dem Artikel:

"Kagan gründete vor seiner Tätigkeit bei Nvidia Mellanox, ein Unternehmen, das sehr stark von Trading profitiert hat und viele Broker und Banken mit Technik für Aktienhandel ausgestattet hat. Er stellt außerdem klar, dass ein Unternehmen wie Nvidia Prozesse wie Mining nicht unterstütze, nur weil die Nutzer die Grafikkarten dafür gekauft hätten."

Der Kagan hat also vorher von Trading profitiert (ein Schelm, der da nicht unter anderem an Krypto denkt...

) aber jetzt ist für ihn KI die Zukunft.... und Minig ist böse und man distanziert sich davon. Wieso lässt man so jemand überhaupt öffentliche Aussagen im Namen eines Unternehmens tätigen... Mal sehen was er sagt, wenn Krypto wieder interessant wird (BTC steigt schon wieder und der Boden ist wahrscheinlich drin - somit auch viele andere Coins).

) aber jetzt ist für ihn KI die Zukunft.... und Minig ist böse und man distanziert sich davon. Wieso lässt man so jemand überhaupt öffentliche Aussagen im Namen eines Unternehmens tätigen... Mal sehen was er sagt, wenn Krypto wieder interessant wird (BTC steigt schon wieder und der Boden ist wahrscheinlich drin - somit auch viele andere Coins).Außerdem bin ich gespannt, was er über den Einsatz der Grafikkarten für Computerspiele hält

Mylo

Software-Overclocker(in)

Hä?Auf welches Verhalten nimmst du Bezug? Auf welche Aussage bezüglich Mining?

Warum machst du das Nvidia zum Vorwurf? Oder anders gefragt, stellt sich Nvidia denn hin und behauptet keine GPUs an Miner verkauft zu haben?

In der Originalquelle steht doch, wie es gemeint ist, nicht so verkürzt wie in diesem Newsschnipsel.

"

All this crypto stuff, it needed parallel processing, and [Nvidia] is the best, so people just programmed it to use for this purpose. They bought a lot of stuff, and then eventually it collapsed, because it doesn’t bring anything useful for society. AI does,” Kagan told the Guardian.

“With ChatGPT, everybody can now create his own machine, his own programme: you just tell it what to do, and it will. And if it doesn’t work the way you want it to, you tell it ‘I want something different’.”

Crypto, by contrast, was more like high-frequency trading, an industry that had led to a lot of business for Mellanox, the company Kagan founded before it was acquired by Nvidia.

“We were heavily involved in also trading: people on Wall Street were buying our stuff to save a few nanoseconds on the wire, the banks were doing crazy things like pulling the fibres under the Hudson taut to make them a little bit shorter, to save a few nanoseconds between their datacentre and the stock exchange,” he said.

“I never believed that [crypto] is something that will do something good for humanity. You know, people do crazy things, but they buy your stuff, you sell them stuff. But you don’t redirect the company to support whatever it is.”

ok ich merk schon. Bringt nichts...

Mironicus1337

PC-Selbstbauer(in)

Ich habe mich in meinem Beitrag an keiner Stelle derart geäußert, Nvidia unterläge einem Zwang.Quatsch, keiner hat Nvidia dazu gezwungen extra Miningkarten, ohne Displayanschlüsse zu bauen und sie dann auch noch vom Gaming auszusperren.

Das ist eine rein Produktpolitische Entscheidung. Man hat auch ältere Chips für Mining angepasst, das Kartendesign dementsprechend gestaltet, somit dass Serverfarmen viele zusammenstecken können um Produkte für den Gaming und Profi Bereich davon abzugrenzen um alle Channels bedienen zu können, gerade auch weil es Lieferengpässe gab.

Das sind Karten die für das Serverumfeld zugeschnitten wurden.Das ganze wurde nur gemacht, um die Karten vom Gebrauchtmarkt fernzuhalten.

Das sind keine Karten für einen Gebrauchtmarkt.

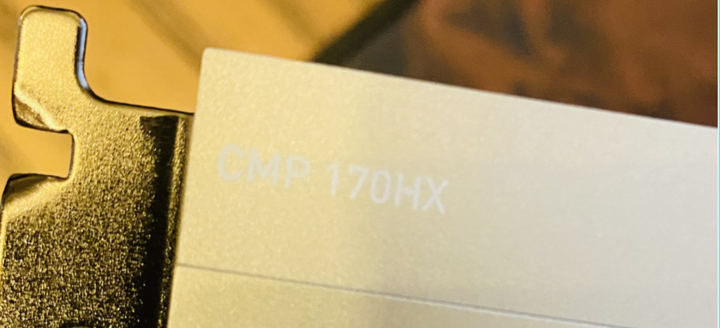

CMP 170HX 不完全指南

外观方面:被动散热;造型和A100基本相同,但明显少了Tesla的精致;双卡槽厚度。CPU 8pin插口,需要转接线 。 参数方面:4480个cuda核心,70个SM,核心阉割约等于3080(68 SM)核心;8GB 海力士HBM2显存,4096bit …

Natürlich versucht eine Firma Geld zu machen, das Ziel ist doch genau das.Nvidia wollte Geld machen, sonst nichts.

Aber nicht weil man keine Displayanschlüsse verbaut. Diese braucht man im Serverumfeld einfach nicht...

Spezialisierte Serverkarten sind nicht für einen Gamingeinsatz im privaten Umfeld gedacht und haben andere Anforderungen.Es geht Nvidia nur darum, die Miner gesondert zur Kassen zu bitten und dass die Karten danach kein zweites Gamingleben haben.

Diese fließen nicht in den Gebrauchtmarkt. Äpfel und Birnen.

Dann würde die ganze Serverbranche durchweg Elektroschrott produzieren, weil nicht für den Otto Normalverbraucher Markt kompatibel, auch da wird massig Hardware ohne entsprechende Anschlüsse und 0815 Kühlsysteme produziert, die nicht in ein mATX Gehäuse passen. Auch eine Verdongelung ist üblich um vor allem die Qualität der Produkte für den Einsatzbereich zu garantieren.Sorry, das genaue Gegenteil ist der Fall, denn der Sinn ist es Elektroschrott zu erzeugen.

Verschwörungstheorien stehen heutzutage hoch im Kurs.Der einzige Zweck ist es, dass diese Karten nicht auf den Gebrauchtmarkt kommen und dort neue Karten verdrängen.

Ich verstehe nicht warum der Diskurs auf diese Art und Weise geführt wird. Das ist ja Bild Zeitungs Jargon.

Diese Aussage zeigt, dass du das Interview gar nicht gelesen hast, denn darauf geht der CTO ausführlich ein.Jetzt nachdem man top verdient hat daran redet es sich leicht...

Ich habe es in einem älteren Beitrag komplett zitiert.

Offenbar geht es hier rein um eine nicht sachdienliche Empörungskultur.

Die Motive dahinter habe ich bis jetzt nicht überblickt.

Zuletzt bearbeitet:

S

sonny1606

Guest

So lange es die Kunden kaufen darf sich niemand beschweren. Gaming-GPU ist an sich ein reines Luxus-Spielzeug. Gamer denen die gpu's zu teuer sind könnten auch einfach mal doe Generation nicht kaufen. NV wird dann schon Druck bekommen wenn die ihre Bauteile nicht loswerden. Aber leider kaufen einfach die Kunden alles zu jedem Preis.Der gesellschaftliche Mehrwert von Nvidia entzieht sich mir mittlerweile auch.

Nvidia ist dabei die Plattform PC maßgeblich und nachhaltig zu schädigen, indem man die Plattform als Luxusgut platzieren will. Jede Technik dient der Monopolstellung und Ausschluss des Wettbewerbs.

Es wäre besser Nvidia würde seine eigene Plattform gründen wie Apple.

Dann kann man sich abheben und kann seine Deckungsbeiträge erhöhen.

Typisches PR Geblubber um sich nachhaltig dank PR Aktionen vor einem Shitstorm zu retten.

Da distanziert sich man lieber schnell vom Poor Dog. ^^

G

Gast1681636201

Guest

Nvidia: "Kryptowährungen liefern keinen gesellschaftlichen Mehrwert" - Fokus soll lieber auf KI gelegt werden

NVidia meint wohl eher man verdient nicht mehr genug an GPUs weil sie für das Mining uninteressant und obsolet geworden sind.

Mit der KI verhält es sich genau gleich wie mit den Kryptos. Es wurde ein großer Hype initiiert, welcher etwas ganz anderes darstellt als das was es wirklich ist.

NVidia spricht von gesellschaftlichen Mehrwert, meint damit aber den Mehrwert welche Ihnen die Gesellschaft bringt.

OField

Software-Overclocker(in)

NVidia hat recht. Krypto ist keine Wertschöpfung, sondern nur eine Spekulationsobjekt bzw. Lotterie, wo manche das Geld gewinnen, welches andere ohne Gegenleistung verlieren, und das ganze verbraucht dann so viel Strom wie ganze Staaten. KI kann immerhin Arbeit vollrichten.

Zuletzt bearbeitet:

Mironicus1337

PC-Selbstbauer(in)

Nvidia kann den Einsatzzweck der verkauften GPUs nicht bestimmen , insofern steht die Aussage nicht im Widerspruch zum Handeln des Unternehmens. Die Abgrenzung in Mining GPUs ohne entsprechendes aufwändigeres Sampling, Bestückung, Kühlung und Co, auch die LHR GPUs und das Freischaufeln von Fertigungskapazitäten für die den ursprünglichen Einsatzzweck zeigen, dass Nvidia nicht einfach nur kopflos gehandelt hat."Er stellt außerdem klar, dass ein Unternehmen wie Nvidia Prozesse wie Mining nicht unterstütze, nur weil die Nutzer die Grafikkarten dafür gekauft hätten."

Und selbst wenn er persönlich den gesellschaftlichen Zweck anzweifelt, werden Unternehmen die Produktion wieder hochfahren, sollte das Thema wieder aufflammen. Selbst aktuell wird in Ländern mit geringen Stromkosten noch Mining betrieben.Der Kagan hat also vorher von Trading profitiert (ein Schelm, der da nicht unter anderem an Krypto denkt...) aber jetzt ist für ihn KI die Zukunft.... und Minig ist böse und man distanziert sich davon.

Inwiefern ist die Aussage problematisch?Wieso lässt man so jemand überhaupt öffentliche Aussagen im Namen eines Unternehmens tätigen...

Was hat er denn damals gesagt? Hast du dazu Informationen?Mal sehen was er sagt, wenn Krypto wieder interessant wird (BTC steigt schon wieder und der Boden ist wahrscheinlich drin - somit auch viele andere Coins).

Welche Alternative schlägst du vor?Mich stört nicht das sie Geld machen sondern wie sie es machen.

Natürlich profitiert ein Unternehmen, wenn sie im AI Bereich partizipieren und an der Spitze momentan wenig Konkurrenz zu fürchten haben.und mit der KI geschichte können sie es in die länge ziehen damit bleibt der Markt mit der Preisgestaltung weit oben und wir verbrauch haben wenig was dagegen zu tuen.

Das ist aber Resultat einer langwierigen Entwicklung, schwierigen Entscheidungen und hohen Investitionen, auch verbunden mit hohen Risiken. Verbraucher haben mit AI sowieso wenig am Hut, die kaufen GeForce Produkte.

Der Fokus von Nvidias Produkten lag zudem schon immer auf AI, nie auf Crypto.

Zuletzt bearbeitet:

Mein Bruder hat am WE versucht beim Mini Cooper One die Reifendruck Anzeige zurückzusetzen. Internetforen haben nach 5 min Suche nicht das erfolgreiche Ergebnis gebracht. ChatGPT auf Anhieb eine perfekte Schritt für Schritt Anleitung geliefert. Ich habe in meiner Behörde anhand von Stichpunkten einen Text verfasst und ich wette mit 2 bis 3 Stichpunkten wäre mittels ChatGPT auch der eine oder andere Artikel in PCGH besser verfasst und eventuell sogar besser recherchiert.

Ich habe keinen Mini, aber in der Bedienungsanleitung meines Autos habe ich spontan binnen 15 Sekunden die entsprechende Anleitung gefunden. Die Frage bei komplexeren Dinge, die man nirgendwo nachschlagen kann, ist aber nicht, ob ChatGPT richtige Antworten liefern kann. Die Frage ist, ob es das zuverlässig tut. Denn wenn man die Antwort erst durch zusätzliche Recherche verifizieren muss, weil sie falsch sein könnte, dann hat man ohnehin den gleichen Aufwand wie ganz ohne ChatGPT.

Es ist aber bereits aus anderen fehleranfälligen Quellen bekannt, dass viele Leute sich diese Mühe nicht machen, und Aussagen ungeprüft aus zum Beispiel Boulevard-Medien, Youtube oder von Verschwörungstheoretikern übernehmen. Diese Leute werden das auch von ChatGPT machen. Solange es nur um eine Reifendruckanzeige geht, ist das verschmerzbar. Wenn der Mechaniker, der deine Bremsen warten soll, ebenfalls noch nie etwas von "RTFM", aber viel von "KI" gehört hat, bekommst du aber gegebenenfalls ein richtiges Problem, falls sich die Wartungsanleitung ChatGPT fehlerhaft war. Und wenn es um politische Themen geht, bekommen alle ein solches Problem, gegebenenfalls weltweit. Der Begriff "Fake News" ist nicht umsonst wegen eines gewissen US-Populisten zum geflügelten Wort geworden, der es mit der Wahrheit weniger genau nahm. Vergleichbare Absichten im Hintergrund sind bei ChatGPT zwar weniger zu erwarten (auch wenn sie sich aus Trainingsdaten ergeben könnten), aber die alte Vorsichtsmaßnahme "traue niemandem, der schon häufiger gelogen hat", gilt trotzdem.

Du kannst natürlich trotzdem versuchen, deine Hardware-Empfehlungen von KI-Bots zu beziehen. Wenn du Glück hast, hat ChatGPT (Urheberrechtswidrig und ohne die geleistete Arbeit zu bezahlen) Ergebnisse von uns oder von vergleichbar sorgfältig arbeitenden Redaktionen verwendet. Wenn du Pech hast Werbe-Texte von AMD, Intel oder Nvidia, die dir dann ohne Kennzeichnung des offensichtlichen Bias als "Wahrheit" serviert werden.

Einer Firma wie Nvidia/AMD oder Intel jucken sich nicht an was die Gesellschaft will sondern das was Profit anscheist. Es gibt auf der Welt kaum eine Firma die Gesellschaftlich das Intresse verfolgt. Solche Aussagen sind Quatsch. Und mit AI werden wir auch früher oder später zu tuen haben. Meiner Meinung nach sind viele Sachen nie im Verhältnis zu dem was wirklich passiertDas ist aber Resultat einer langwierigen Entwicklung, schwierigen Entscheidungen und hohen Investitionen, auch verbunden mit hohen Risiken. Verbraucher haben mit AI sowieso wenig am Hut, die kaufen GeForce Produkte.

Der Fokus von Nvidias Produkten lag zudem schon immer auf AI, nie auf Crypto.

Scorpionx01

BIOS-Overclocker(in)

Das war ja nicht sein Mini. Er wollte nur einer Freundin behilflich sein. Das Handbuch nicht vorhanden.Ich habe keinen Mini, aber in der Bedienungsanleitung meines Autos habe ich spontan binnen 15 Sekunden die entsprechende Anleitung gefunden. Die Frage bei komplexeren Dinge, die man nirgendwo nachschlagen kann, ist aber nicht, ob ChatGPT richtige Antworten liefern kann. Die Frage ist, ob es das zuverlässig tut. Denn wenn man die Antwort erst durch zusätzliche Recherche verifizieren muss, weil sie falsch sein könnte, dann hat man ohnehin den gleichen Aufwand wie ganz ohne ChatGPT.

Es ist aber bereits aus anderen fehleranfälligen Quellen bekannt, dass viele Leute sich diese Mühe nicht machen, und Aussagen ungeprüft aus zum Beispiel Boulevard-Medien, Youtube oder von Verschwörungstheoretikern übernehmen. Diese Leute werden das auch von ChatGPT machen. Solange es nur um eine Reifendruckanzeige geht, ist das verschmerzbar. Wenn der Mechaniker, der deine Bremsen warten soll, ebenfalls noch nie etwas von "RTFM", aber viel von "KI" gehört hat, bekommst du aber gegebenenfalls ein richtiges Problem, falls sich die Wartungsanleitung ChatGPT fehlerhaft war. Und wenn es um politische Themen geht, bekommen alle ein solches Problem, gegebenenfalls weltweit. Der Begriff "Fake News" ist nicht umsonst wegen eines gewissen US-Populisten zum geflügelten Wort geworden, der es mit der Wahrheit weniger genau nahm. Vergleichbare Absichten im Hintergrund sind bei ChatGPT zwar weniger zu erwarten (auch wenn sie sich aus Trainingsdaten ergeben könnten), aber die alte Vorsichtsmaßnahme "traue niemandem, der schon häufiger gelogen hat", gilt trotzdem.

Du kannst natürlich trotzdem versuchen, deine Hardware-Empfehlungen von KI-Bots zu beziehen. Wenn du Glück hast, hat ChatGPT (Urheberrechtswidrig und ohne die geleistete Arbeit zu bezahlen) Ergebnisse von uns oder von vergleichbar sorgfältig arbeitenden Redaktionen verwendet. Wenn du Pech hast Werbe-Texte von AMD, Intel oder Nvidia, die dir dann ohne Kennzeichnung des offensichtlichen Bias als "Wahrheit" serviert werden.

Es hörte und hört sich immer noch so an, als würdest du KI als nutzlos bezeichnen. Ich habe ChatGPT mit Stichpunkten gefüttert. Heraus kam ein schöner Text. Hat mir ungefähr eine bis zwei Stunden erspart. Es gibt schon Redaktionen die sich Texte verfassen lassen. Heißt ja nicht, dass man ChatGPT zwingend recherchieren lassen muss.

In der Kriegsführung werden bereits Fotos aus Beflügen mittels KI ausgewertet und nach Panzern abgesucht. Kein schönes Beispiel, aber es zeigt ganz klar. Wer nicht auf KI setzt, bleibt vermutlich auf der Strecke.

PS: Gibt auch positive Beispiele... wie die Müllaortierung...

Zuletzt bearbeitet:

KI ist überall da wertvoll, wo Fehler akzeptabel sind und wo man ohne KI bislang gar nichts oder nur sehr wenig gemacht hat. Militärische Bildauswertung ist so ein Fall, weil es einfach zu viele Bilder gibt. Sobald die gleichen Methoden von Diktatoren genutzt werden, um politische Abweichler zu finden und zu töten, wird dieser technische Vorteil aber gegebenenfalls nicht mehr als solcher bezeichnet werden. Die viel genannten KI-Beispiele "Autofahren" und "medizinische Analysen" verorte bezüglich "macht bislang kaum jemand" und "Fehler akzeptabel" allgemein anders; bei Müllsortierung bin ich nicht hinreichend informiert. Bislang wurden die Erkennungssysteme von Hand programmiert und haben gut funktioniert. Vielleicht könnte man mit KI siowie viel Energie und Hardware aus dem "gut" ein "besser" machen – realistischer ist aber, dass man die für eine zielstrebig konstruierte Lösung nötigen, teuren Fachkräfte einsparen möchte und stattdessen lieber solange Niedrigstlöhner den Müll von Hand sortieren lässt (= Trainingsdaten für die KI generieren), bis man eine gerade eben so "ausreichende" Automatik erhält.

Negative Folgen aus KI-Einsatz erwarte ich daher überall dort, wo man sich schon bislang über fehlende Quantität nicht beschweren konnte, fehlende Qualität aber ein Problem war. Hardware-Berichterstattung ist sicherlich ein gutes Beispiel. Das Urteil über meine eigenen Artikel überlasse ich anderen, aber wenn ich selbst recherchiere (zugeben: Das sind meist Härtefälle) spucken die Suchmaschinen reihenweise automatisch generierte Preisvergleichsseiten ganz ohne Inhalt, Shops, Hersteller-Eigenwerbung, gekaufte Werbe-Artikel und ähnliches aus – aber viel zu selten seriöse Tests oder fundierte Analysen. Eine KI, welche die Erstellung von noch mehr Text auf Basis von noch weniger Inhalt ermöglicht, verspricht hier keine Verbesserung. Sie erleichtert es vor allem den Spamern, zusätzliche Fake-Seiten zu erstellen. Und auch als Ersatz für eine ordentliche Bedienungsanleitung vom Auto-Hersteller taugt ChatGPT meiner Meinung nach nicht, denn es kennt das Auto nicht. Bestenfalls zitiert es aus der richtigen Anleitung, wenn die in seinen Trainingsdaten enthalten war. Aber wesentlich besser wäre es doch, wenn der Hersteller eben diese Anleitung auch nicht-KIs direkt und ohne Zwang zu einer App mit Account zugänglich macht, oder? ChatGPT ist hier nur ein Gatekeeper vor Informationen, die Menschen bewusst vorenthalten werden. Den Zugang zu verbessern erfordert keine neue KI-Technik, sondern "html" oder "pdf Download" und eine andere Firmenpolitik.

Negative Folgen aus KI-Einsatz erwarte ich daher überall dort, wo man sich schon bislang über fehlende Quantität nicht beschweren konnte, fehlende Qualität aber ein Problem war. Hardware-Berichterstattung ist sicherlich ein gutes Beispiel. Das Urteil über meine eigenen Artikel überlasse ich anderen, aber wenn ich selbst recherchiere (zugeben: Das sind meist Härtefälle) spucken die Suchmaschinen reihenweise automatisch generierte Preisvergleichsseiten ganz ohne Inhalt, Shops, Hersteller-Eigenwerbung, gekaufte Werbe-Artikel und ähnliches aus – aber viel zu selten seriöse Tests oder fundierte Analysen. Eine KI, welche die Erstellung von noch mehr Text auf Basis von noch weniger Inhalt ermöglicht, verspricht hier keine Verbesserung. Sie erleichtert es vor allem den Spamern, zusätzliche Fake-Seiten zu erstellen. Und auch als Ersatz für eine ordentliche Bedienungsanleitung vom Auto-Hersteller taugt ChatGPT meiner Meinung nach nicht, denn es kennt das Auto nicht. Bestenfalls zitiert es aus der richtigen Anleitung, wenn die in seinen Trainingsdaten enthalten war. Aber wesentlich besser wäre es doch, wenn der Hersteller eben diese Anleitung auch nicht-KIs direkt und ohne Zwang zu einer App mit Account zugänglich macht, oder? ChatGPT ist hier nur ein Gatekeeper vor Informationen, die Menschen bewusst vorenthalten werden. Den Zugang zu verbessern erfordert keine neue KI-Technik, sondern "html" oder "pdf Download" und eine andere Firmenpolitik.

HyperBeast

Software-Overclocker(in)

So lange es die Kunden kaufen darf sich niemand beschweren. Gaming-GPU ist an sich ein reines Luxus-Spielzeug. Gamer denen die gpu's zu teuer sind könnten auch einfach mal doe Generation nicht kaufen. NV wird dann schon Druck bekommen wenn die ihre Bauteile nicht loswerden. Aber leider kaufen einfach die Kunden alles zu jedem Preis.

Komisch das AMD die selbe Preisgestaltung nutzt. Damit ist eine solche Aussage nicht richtig. Aber nun gut.

Mehrwert, ich weiß nicht so Recht. Aber ich weiß was du meinst. Es war aber ab Tag eins klar, das es nur idiologischer Dünnpfiff ist.

So etwas wie eine unabhängige Währung kann es nie geben.

Deine Argument AMD ist aufgrund der nicht vorhandenen Marktstellung kein Argument.

AMD bestimmt nicht die Preise sondern orientiert sich am Marktführer.

Wir sind im Bereich der GPU`s nicht mit CPU^s verwechseln.

Bobhais

Software-Overclocker(in)

Die Unternehmensausrichtung Nvidias lag seit 2016 auf Deep Learning, bzw. KI/AI.Die vergangenen Jahre wars völlig ok mit Kryptowährungen Geld zu verdienen, jetzt wo das weggebrochen ist und man Milliarden mit DL verdient, wird also das andere als wichtig erachtet

Der Miningwahn war eine willkommene Einnahmequelle, mehr aber auch nicht, das ist auch Inhalt des Interviews mit Herrn Kagan.

Die Überschrift des Artikels ist somit eine Falschdarstellung und soll in erster Linie einen Aufreger für Klickzahlen generieren, nicht informieren.

Nvidia hat die Miningprodukte nach wie vor im Angebot.

Bis auf wenige, positive Ausnahmen ein Theater.Mal abgesehen vom Nvidia-Bashing hier.

Da bist du etwas Großem auf der Spur.Da muss nichts irgendwo gesagt werden. Das Verhalten hat schon gereicht. Und Nvidia hat da sehr bewusst mitgespielt und verdient.

Das hat aber lange gedauert.Offenbar geht es hier rein um eine nicht sachdienliche Empörungskultur.

Stimme übrigens weitgehend mit deinen Ausführungen überein, wobei Nvidia noch mehr hätte tun können, wenn sie gewollt hätten. Sie haben die Mining Blase sehr intelligent genutzt.

Zuletzt bearbeitet:

Rollora

Kokü-Junkie (m/w)

seither ist es offiziell Unternehmensstrategie, begonnen hat das Ganze schon viel früher, ja.Die Unternehmensausrichtung Nvidias lag seit 2016 auf Deep Learning, bzw. KI/AI.

Prinzipiell sind die enorm leistungsfähigen Chips auch sehr flexibel einsetzbar, somit ist es recht egal welcher Aufgabe man sie aussetzt.

Vor allem zu Beginn der GPGPU Zeit wars spannend, als man noch kein Framework dafür hatte und jeder Code-Bastler mal einfach drauf los entwickelt hat. In der Zeit kamen viele Anwendungen und man dachte sich "oh cool, das geht auch auf einer GPU"

derneuemann

Volt-Modder(in)

AMD bestimmt seine Preise selbst und hat das in Vergangenheit auch stets gemacht. AMD könnte problemlos die 7900XTX auch für 899€ anbieten und die XT für 799€ wenn man wollte und man sich mit den eigenen Kosten nicht verkalkuliert. Dann würden auch mehr Leute diese kaufen. Dann wäre das P/L Verhältnis tatsächlich auch besser.Deine Argument AMD ist aufgrund der nicht vorhandenen Marktstellung kein Argument.

AMD bestimmt nicht die Preise sondern orientiert sich am Marktführer.

Wir sind im Bereich der GPU`s nicht mit CPU^s verwechseln.

Nur weil Nvidia eine 4080 für 1350€ anbietet, muss AMD eine Konkurrenzkarte nicht zum ähnlichen Preis anbieten. AMD bietet so an, wie die meinen das Maximum für sich selbst raus zu holen.

Bobhais

Software-Overclocker(in)

Niemand hindert AMD daran deren Produkte günstiger anzubieten, auch nicht der Marktführer. Was AMD hindert sind die eigenen Kalkulationen und Gewinnabsichten.Deine Argument AMD ist aufgrund der nicht vorhandenen Marktstellung kein Argument.

Beide Hersteller sind in der Preisgestaltung nicht an den anderen gebunden.AMD bestimmt nicht die Preise sondern orientiert sich am Marktführer.

HyperBeast

Software-Overclocker(in)

Niemand hindert AMD daran deren Produkte günstiger anzubieten, auch nicht der Marktführer. Was AMD hindert sind die eigenen Kalkulationen und Gewinnabsichten.

Beide Hersteller sind in der Preisgestaltung nicht an den anderen gebunden.

??????

Na du hast die Marktformen verstanden. Schau dir nochmal die Preisbildung auf Push und Pull Märkten an.

Target Pricing?

Angebotsmonopol?

Nachfragemonopol?

Preiselastizität?

AMD ist in der Preisgestaltung ungebunden?

Alles klar so einfach ist das.

AMD wird nicht gehindert sondern hat von der extremen marktschädigenden Preisgestaltung durch Nvidia profitiert.

Die 7900er Serie wurde für 1000$ entwickelt aber Nvidia hat den Markt völlig überzogen, also führt AMD die Produkte teurer ein. AMD bildet die Preise im Windschatten.

Nutzen für AMD

Pech für Käufer

Katastrophe von Nvidia da der PC Markt so nachhaltig geschädigt wird.

Zuletzt bearbeitet:

Ähnliche Themen

- Antworten

- 22

- Aufrufe

- 823

- Antworten

- 33

- Aufrufe

- 2K

- Antworten

- 26

- Aufrufe

- 1K

R

- Antworten

- 4

- Aufrufe

- 409

Das Geld haben die natürlich wie alle anderen gerne mitgenommen, im nachhinein zu sagen "hat keinen gesellschaftlichen Mehrwert" ist schon etwas strange.

Das Geld haben die natürlich wie alle anderen gerne mitgenommen, im nachhinein zu sagen "hat keinen gesellschaftlichen Mehrwert" ist schon etwas strange.